روش عملکرد یادگیری عمیق (Deep Learning): از نورون تا هوش مصنوعی 🧠🤖

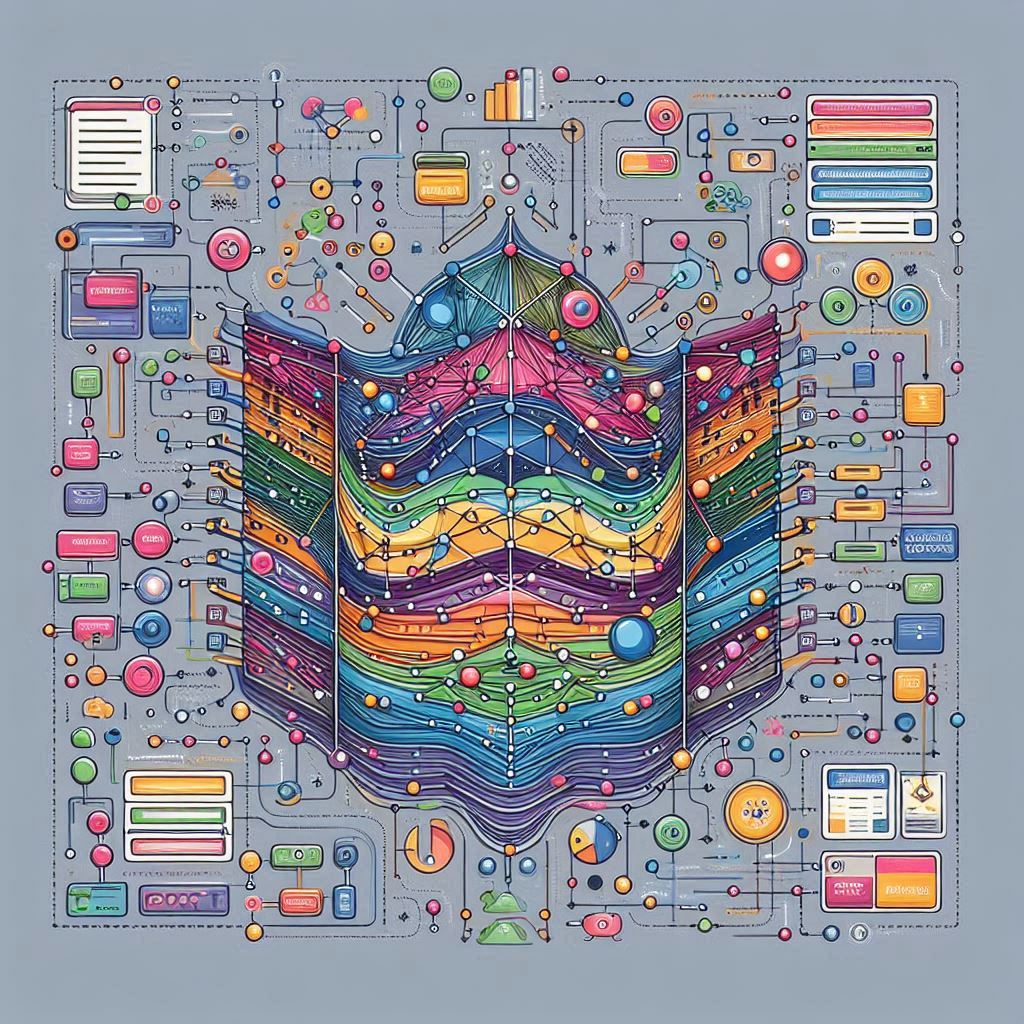

یادگیری عمیق (Deep Learning)، زیرمجموعهای از یادگیری ماشین، با الهام از ساختار مغز انسان، انقلابی در حل مسائل پیچیده ایجاد کرده است. در این مقاله، به زبان ساده مراحل عملکرد یادگیری عمیق را بررسی میکنیم و نشان میدهیم چگونه شبکههای عصبی عمیق، الگوها را از دادهها استخراج میکنند.

🔍 یادگیری عمیق چیست؟

یادگیری عمیق مبتنی بر شبکههای عصبی مصنوعی با چندین لایه پنهان (Hidden Layers) است که:

✅ دادههای خام را به نمایشهای سلسلهمراتبی تبدیل میکند.

✅ برای مسائلی مانند تشخیص تصویر، پردازش زبان طبیعی (NLP) و خودروهای خودران استفاده میشود.

✅ نیاز به حجم زیادی از داده و قدرت محاسباتی دارد.

🧠 ساختار شبکه عصبی عمیق

1. نورون مصنوعی (Artificial Neuron)

هر نورون با این فرمول عمل میکند:

خروجی = تابع_فعالسازی(ورودی × وزن + بایاس)

2. لایههای شبکه

| لایه | نقش | مثال |

|---|---|---|

| ورودی (Input) | دریافت داده خام | پیکسلهای تصویر |

| پنهان (Hidden) | استخراج ویژگیها | تشخیص لبهها در تصویر |

| خروجی (Output) | تولید پیشبینی نهایی | کلاس شیء در تصویر |

⚙️ مراحل یادگیری عمیق

1. پیشروی (Forward Propagation)

داده از لایه ورودی عبور کرده و با محاسبه وزنها و بایاسها به خروجی تبدیل میشود.

2. محاسبه خطا (Loss Function)

خطای پیشبینی با توابعی مانند MSE (برای رگرسیون) یا Cross-Entropy (برای طبقهبندی) اندازهگیری میشود.

3 انتشار معکوس (Backpropagation)

با استفاده از قاعده زنجیرهای (Chain Rule)، گرادیان خطا نسبت به پارامترها محاسبه میشود تا وزنها بهروزرسانی شوند.

4. بهینهسازی (Optimization)

الگوریتمهایی مانند گرادیان کاهشی (Gradient Descent) وزنها را برای حداقلسازی خطا تنظیم میکنند:

وزن_جدید = وزن_قدیم - نرخ_یادگیری × گرادیان

📊 انواع شبکههای عمیق

| نوع شبکه | کاربرد | ساختار |

|---|---|---|

| CNN | پردازش تصویر | لایههای کانولوشن و Pooling |

| RNN | پردازش متن/زمانسری | حلقههای بازگشتی |

| Transformer | ترجمه ماشینی | مکانیزم توجه (Attention) |

| GAN | تولید داده مصنوعی | شبکه مولد و تشخیصدهنده |

🧩 مثال عملی: تشخیص رقم دستنویس با CNN

from tensorflow import keras

# ساخت مدل

model = keras.Sequential([

keras.layers.Conv2D(32, (3,3), activation='relu', input_shape=(28,28,1)),

keras.layers.MaxPooling2D((2,2)),

keras.layers.Flatten(),

keras.layers.Dense(10, activation='softmax')

])

# کامپایل و آموزش

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

model.fit(X_train, y_train, epochs=10)

🔥 مزایا و چالشها

مزایا:

-

نیاز به مهندسی ویژگی دستی را حذف میکند.

-

عملکرد فوقالعاده در دادههای ناهمبسته (مانند تصاویر).

چالشها:

-

نیاز به داده زیاد: معمولاً میلیونها نمونه نیاز است.

-

مصرف محاسباتی بالا: نیاز به GPUهای قدرتمند.

-

قابلیت تفسیرپذیری پایین: مدلهای "جعبه سیاه".

🔮 آینده یادگیری عمیق

-

شبکههای عصبی اسپارس (SNN): شبیهسازی دقیقتر مغز

-

یادگیری انتقالی (Transfer Learning): کاهش نیاز به داده

-

ادغام با یادگیری تقویتی (RL): سیستمهای خودمختار

🎯 نتیجهگیری

یادگیری عمیق با تقلید از مغز انسان، امکان حل مسائلی را فراهم کرده که تا یک دهه پیش غیرممکن بودند. با این حال، درک نحوه عملکرد آن برای بهبود مدلها و اجتناب از خطاها ضروری است.

سوال بحث:

آیا فکر میکنید روزی هوش مصنوعی عمومی (AGI) با استفاده از یادگیری عمیق ساخته شود؟ 💭

نویسنده

سیدهادی موسوی

Tags: #علمی #تئوری #برنامه_نویسی #مقاله